面向复杂场景的高精度实时视觉目标追踪技术研究与应用进展分析

文章摘要:

面向复杂场景的高精度实时视觉目标追踪技术,是计算机视觉与人工智能领域中具有代表性和挑战性的研究方向之一。随着智能感知需求的不断提升,该技术在自动驾驶、智能安防、无人系统、人机交互等多个领域中发挥着越来越重要的作用。复杂场景通常表现为目标外观变化剧烈、遮挡频繁、光照条件多变以及背景干扰严重,这些因素对视觉目标追踪算法的稳定性、实时性与精度提出了更高要求。近年来,深度学习、强化学习以及多模态感知等新方法的引入,显著推动了高精度实时目标追踪技术的理论突破与工程应用。本文围绕面向复杂场景的高精度实时视觉目标追踪技术研究与应用进展,从技术发展背景、关键算法演进、复杂场景应对策略以及典型应用与发展趋势四个方面展开系统分析,力求全面呈现该领域的研究脉络、技术难点与未来方向,为相关研究与工程实践提供参考与借鉴。

1、技术发展背景

视觉目标追踪技术起源于早期的计算机视觉研究,其核心目标是在连续视频序列中持续定位特定目标。最初的研究多依赖人工设计特征和简单的运动模型,适用于背景相对单一、目标变化较小的理想场景。

随着应用需求的扩大,现实环境中复杂因素逐渐显现,如非刚性形变、快速运动和多目标干扰等,使传统方法在精度和鲁棒性方面暴露出明显不足。这一背景促使研究者不断探索更具适应性的追踪框架。

近年来,计算能力的提升和大规模数据集的出现,为视觉目标追踪技术的发展提供了重要支撑。高性能GPU和嵌入式算力平台,使得复杂模型能够在实时条件下运行,为高精度追踪奠定了基础。

2、关键算法演进

相关滤波算法是视觉目标追踪领域的重要里程碑,其通过高效的频域计算实现了速度与精度的良好平衡,在一段时间内成为主流方法之一。

深度学习的引入,极大地改变了目标追踪算法的设计范式。基于卷积神经网络的特征表示,显著增强了模型对外观变化和复杂背景的表达能力。

近年来,孪生网络、Transformer结构以及端到端训练策略不断涌现,使目标追踪从“在线更新”为主逐步转向“离线学习+在线推理”的新模式,在复杂场景下表现出更强的稳定性。

3、复杂场景应对策略

针对遮挡问题,研究者提出了多种鲁棒建模方法,如引入注意力机制和上下文建模,以提升模型对局部信息丢失情况下的整体判断能力。

在光照变化和背景干扰显著的场景中,多尺度特征融合和自适应权重调整机制被广泛应用,有效缓解了环境变化对追踪结果18新利的影响。

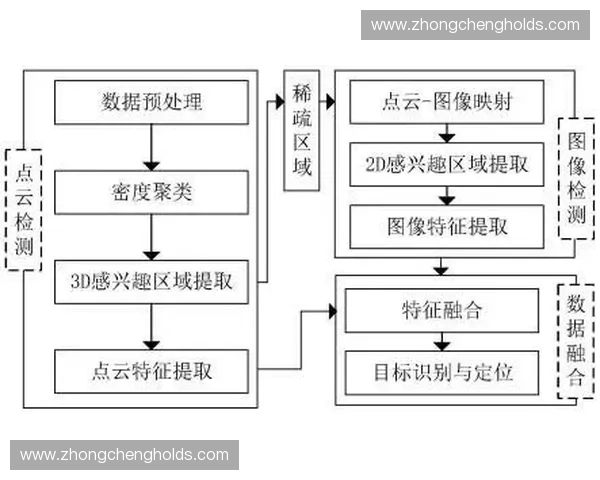

此外,多模态信息融合成为新的研究热点,通过结合深度信息、红外数据或运动传感数据,进一步增强了系统在极端复杂场景下的追踪可靠性。

4、应用实践与趋势

在自动驾驶领域,高精度实时视觉目标追踪技术被用于行人、车辆及障碍物的持续感知,是实现安全决策的重要基础。

在智能安防和无人系统中,该技术支持对重点目标的长时间稳定跟踪,提高了系统的智能化水平和响应效率。

展望未来,轻量化模型设计、跨场景泛化能力以及与大模型和多智能体系统的结合,将成为视觉目标追踪技术的重要发展趋势。

总结:

总体来看,面向复杂场景的高精度实时视觉目标追踪技术在理论方法和工程应用层面均取得了显著进展。从早期的传统算法到深度学习驱动的现代方法,技术演进不断提升系统在复杂环境下的鲁棒性与实用性。

未来,随着应用场景的进一步拓展和智能系统需求的不断提升,该领域仍将面临诸多挑战与机遇。持续推动算法创新与应用融合,将是实现高精度、强泛化、低延迟视觉目标追踪系统的关键方向。